速報!GLM 5、ついにリリース:Zhipu AIの最新フラッグシップモデルがAIの未来を再定義

速報!GLM 5、ついにリリース:Zhipu AIの最新フラッグシップモデルがAIの未来を再定義

2026年2月11日早朝、Zhipu AI(Z.ai)は、大規模言語モデルGLMシリーズの最新フラッグシップモデルである「GLM 5」を正式にリリースしました1。この新モデルは、チャット、コーディング、エージェントタスクに特化して最適化されており、AIの使用体験を再定義する可能性を秘めています2。Z.aiの公式Xアカウント(@Zai_org)では、同日午前4時37分(日本時間)に新モデルの発表が行われました1。

GLM 5は、前世代のGLM-4.7から大幅なアップデートが施され、創造的ライティング、プログラミング、推論、エージェント能力において画期的な進歩を遂げたとしています2。Zhipu AIは、GLM 5を同社の2026年の目標である「国際的な大手モデル企業」への重要な一歩と位置づけており、AGI(汎用人工知能)技術高地の追求に向けた基盤構築を目指しています3。

リリース時点ですでにchat.z.aiで利用可能となっており、モデルセレクターでは「New」タグ付きで表示されています1。その費用対効果の高さ、オープンな姿勢、およびコーディング特化の機能により、開発者コミュニティからはGLMシリーズへの高い評価と期待が寄せられています1。本報告書では、GLM 5の公式リリース情報、主要なハイライト、目的、および初期概要を詳細にまとめ、この革新的なモデルがAIの未来にどのような影響を与えるかを考察します。

GLM 5とは何か?その背景と進化

GLM 5は、Zhipu AI(Z.ai)が開発した大規模言語モデルGLMシリーズの第5世代フラッグシップモデルであり、AI技術の最前線を切り開く重要な位置づけにあります4。前セクションで述べたように、GLM 5は2026年2月11日に正式リリースされ、チャット、コーディング、エージェントタスクに特化して最適化されています1。その目的は、AIの使用体験を再定義し、Z.aiを国際的な大手モデル企業へと成長させること、さらには汎用人工知能(AGI)の達成に貢献することです2。

GLMシリーズの歴史的背景と主要なマイルストーン

Z.aiは、2019年に清華大学からスピンオフして以来、AI技術の進化を牽引してきました5。初期の「ChatGLM」から始まり、2025年には「Z.ai」として国際ブランドを確立し、グローバル市場へと展開しています5。GLMシリーズは、以下に示すように段階的な進化を遂げてきました。

GLMシリーズの主要モデルの進化を以下に示します。

| モデル名 | リリース年月 | 主要機能・特徴 |

|---|---|---|

| GLM-4.0 | 2024年10月 | 音声対応のエンドツーエンドモデルを導入。 |

| GLM-4.5 | 2025年7月 | 推論、コーディング能力を大幅強化、エージェントタスクに特化。MoEアーキテクチャ(総P数3550億、活性P数320億)、「思考モード」導入。Apache-2.0ライセンスでオープンソース化。 |

| GLM-4.5V | 2025年8月 | GLM-4.5-Airを基盤としたマルチモーダルモデル。「思考モード」とRLCSを採用。STEM問題解決、動画理解、コンテンツ認識、コーディング、グラウンディング、GUIエージェントタスクなどを強化。 |

| GLM-4.6 | 2025年9月 | FP8量子化をサポートし、国産チップに最適化。 |

| GLM-4.7 | 2025年12月 | 3つの思考モード(Interleaved、Preserved、Turn-level)を導入。SWE-benchなどで高スコア。コーディング、エージェント、長文コンテキスト処理に焦点。MoEアーキテクチャ(総P数約4000億、活性P数約320億)、CW 20万トークン。 |

GLM-4.0では音声対応のエンドツーエンドモデルを導入し5、GLM-4.5では推論、コーディング、エージェント能力を大幅に強化しました。特にGLM-4.5ではMoE(Mixture-of-Experts)アーキテクチャや、モデルが推論ステップを内部的に実行する「思考モード」が導入され6、Apache-2.0ライセンスの下でオープンソース化された点も特筆されます7。GLM-4.5VはGLM-4.5-Airを基盤としたマルチモーダルモデルとして登場し、STEM問題解決やGUIベースのエージェントタスクなど多岐にわたる能力が強化されました8。続くGLM-4.6はFP8量子化をサポートし、国産チップに最適化され5、GLM-4.7では3つの思考モードが導入され、SWE-benchなどのベンチマークで高いスコアを記録するなど、コーディングや長文コンテキスト処理に焦点を当てた進化を遂げています9。

GLMシリーズの進化パスを示す概念図です。

GLM 5の進化:GLM 4との比較

GLM 5は、特にGLM 4.x世代と比較して、以下の点で大幅な改善と進化を遂げています。

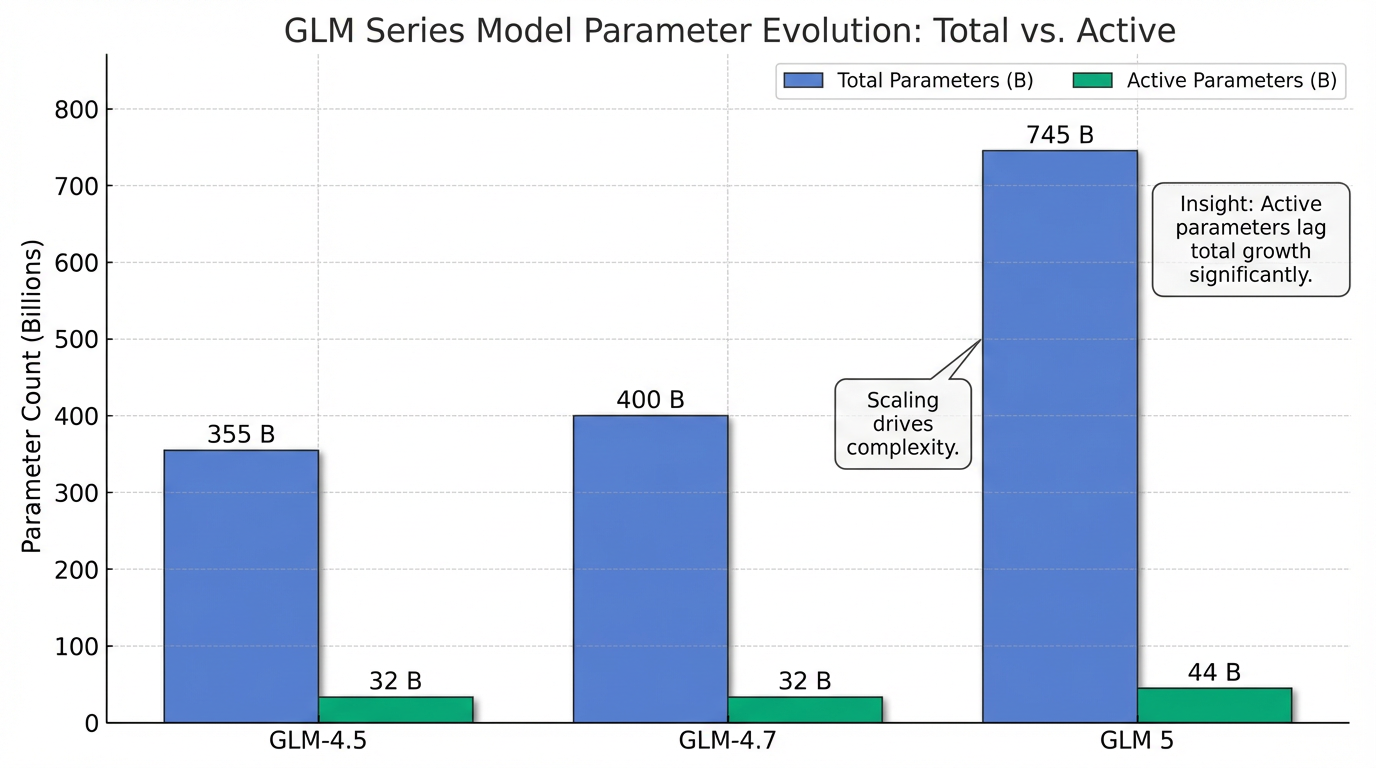

- アーキテクチャの規模: GLM 5は、MoEアーキテクチャを採用し、総パラメータ数が7,450億、活性化パラメータ数(推論時に実際に使用されるパラメータ数)が440億と報告されています。これは、GLM-4.5の総パラメータ数3,550億、活性化パラメータ数320億と比較して、規模が約2倍に拡大していることを意味します6。GitHubコードからは、総パラメータ数7450億、隠れ層78層、専門家256個(毎回8個活性化)、活性化パラメータ数約44Bとされています10。このMoE設計により、大規模ながらも応答速度の速さと長文タスクでの安定性を実現しています4。

- ハードウェア独立性: GLM 5は、Huawei AscendチップとMindSporeフレームワークのみを用いてトレーニングされており、米国製ハードウェアに依存しない完全な独立性を達成している点が大きな特徴です11。

- 推論とコーディング能力の向上: 複雑な推論タスクにおいて、指示がなくても思考プロセスを構築する「思考モード」がさらに強化されており、自己批判的な調整も可能となりました4。コーディングにおいては、完全な書き換えではなく、文脈を維持した増分的な編集をより適切に処理できるよう改善されています4。

- エージェント能力: エージェントタスクにおけるツール呼び出しの明確さや、必要な入力の特定、再試行の提案などが向上し、より洗練されたエージェント機能を提供します4。

- 応答速度と安定性: 初回トークンの遅延が短縮され、長文の回答でも安定したスループット(30〜60トークン/秒)を維持します4。一部でGLM 5の偽装版と推測されるステルスモデル「Pony Alpha」は、非思考モードで約200トークン/秒の速度を提供するとされています7。

- コンテキストウィンドウ: GLM 5は最高202Kトークンに対応しており10、推測されるGLM 5(Pony Alpha)も200,000トークンのコンテキストウィンドウと131,000トークンの最大出力に対応しています12。これはGLM-4.7のコンテキストウィンドウ200,000トークンから、さらに効率的な長文処理が実現されていることを示唆しています5。

GLM 5開発における主要な動機や技術的進歩

GLM 5の開発は、汎用的なマルチモーダル理解と推論を進化させることを主な動機としています8。

- 推論、コーディング、エージェント能力の統合: AIエージェントアプリケーションの複雑な要件に対応するため、推論、コーディング、エージェント能力を単一のモデル内で統合し、より汎用的な能力を発揮することを目指しています6。

- MoEアーキテクチャの最適化: 7,450億もの巨大なパラメータ数を持つMoEアーキテクチャを採用しながらも、DeepSeek稀疏注意力(DSA)とMulti-Token Prediction(MTP)技術の導入により、推論コストと速度を実用的な範囲に保ち、効率性を高めています。このDSAメカニズムは、特に効率的な長文コンテキスト処理を実現します11。

- 「思考モード」の洗練: モデルが内部的に推論ステップを実行し、ユーザーが「どのタイミングでどの程度"考える"か」を制御できるこの機能は、複雑な問題解決やプログラミングタスクにおけるハルシネーション(誤った情報の生成)の抑制に大きく貢献します。GLM 5ではこの機能がさらに強化されています4。

- RLCS(強化学習とカリキュラムサンプリング): GLM-4.5Vの開発でも利用されたこの訓練技術は、特にコーディングやGUIエージェントなどのタスクにおいて、モデルの能力を包括的に向上させるものであり、GLM 5においてもその恩恵を受けています。

- 戦略的オープンソース化と国産ハードウェアへの対応: 特定のハードウェアプラットフォーム(Huawei Ascend)でのトレーニングは、技術的な自立性を確保し、長期的な開発戦略における重要な要素です11。MITライセンスの下でのオープンソース公開は、世界中の開発者の力を借りて技術エコシステムを構築し、クローズドソースモデルの市場支配に挑戦するという戦略的な動きでもあります。

GLM 5は、既存のGLMシリーズの強みを最大限に発展させつつ、より大規模なMoEアーキテクチャ、革新的なトレーニング方法、そしてハードウェアの独立性を通じて、AIエージェントと複雑なタスク解決の分野で次のフロンティアを切り開くことを目指しています。

主要な新機能と改善点

Zhipu AI (Z.ai)から正式にリリースされたGLM 5は、GLM-4.7から大幅にスケールアップし、チャット、コーディング、エージェントタスクに特化して最適化された、Z.aiの最新フラッグシップモデルです 1。GLM 5は、AI使用体験を再定義する可能性を秘めており、国際的な大手モデル企業となるというZhipu AIの2026年の目標達成に向けた重要な一歩と位置づけられています 2。特にインテリジェントなライティングとコード生成分野での実質的な向上が期待されています 2。

1. アーキテクチャの画期的な進化

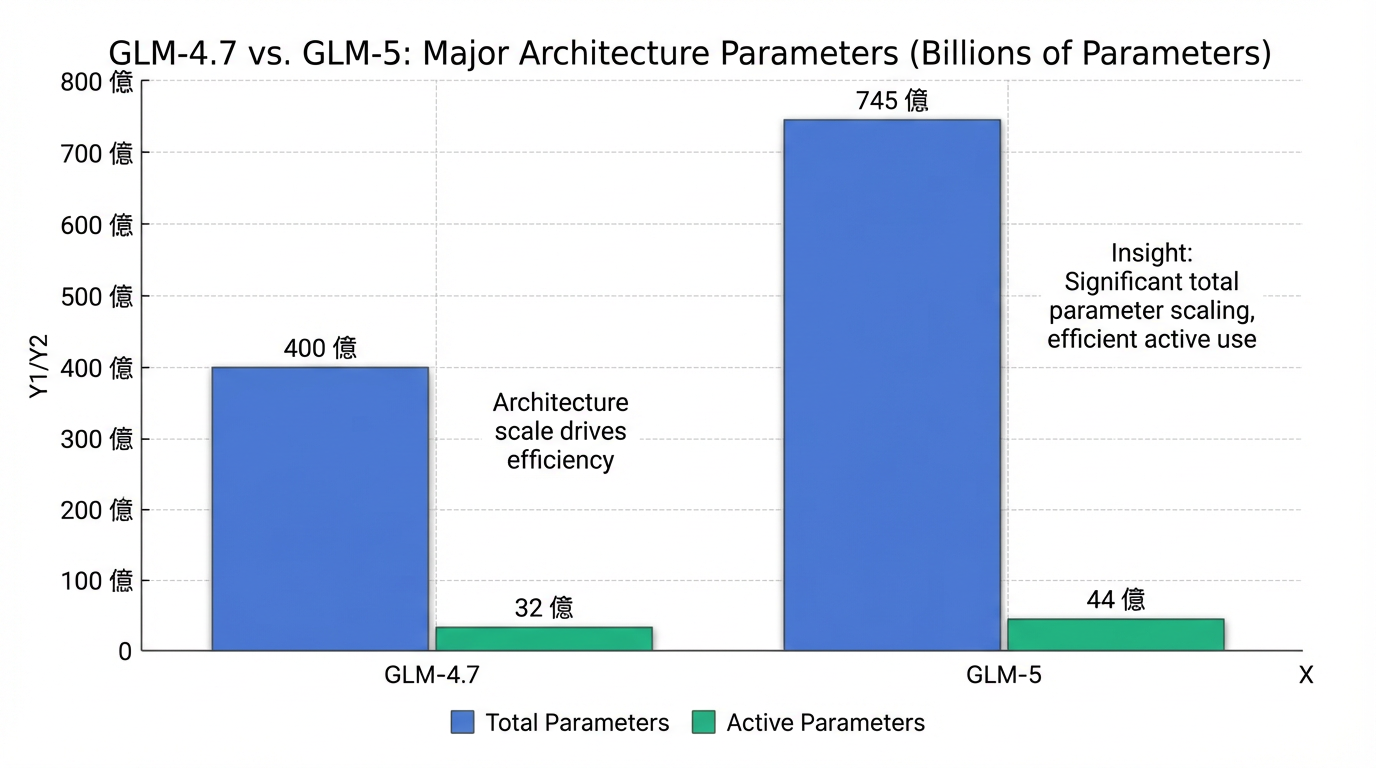

GLM 5の基盤となるアーキテクチャは、DeepSeek-V3/V3.2を採用しており、DeepSeek稀疏注意力(DSA)とMulti-Token Prediction(MTP)技術を導入しています 10。総パラメータ数は7450億(745B)に達し、前世代のGLM-4.7(約400B)と比較して約2倍の規模に拡大しています 10。

GLM 5は78層の隠れ層を持つMoE(混合専門家)アーキテクチャを採用しており、256の専門家を擁し、推論時には毎回8つが活性化されます 10。これにより、約440億(44B)のアクティブパラメータ数が実現されており、GLM-4.7のアクティブパラメータ数約320億(32B)と比較しても性能が向上しています 10。疎度は5.9%で、DeepSeek-V3.2の5.4%と同水準を保っています 10。

このMoE設計は、大規模ながらも応答速度の速さと長文タスクでの安定性を実現し、DeepSeek疎性アテンション(DSA)メカニズムによって効率的な長文コンテキスト処理が可能になっています 4。

GLM 5とGLM-4.7の主なアーキテクチャ比較は以下の通りです。

| モデル名称 | アーキテクチャ | 総パラメータ数 | アクティブパラメータ数 | コンテキストウィンドウ | トレーニングハードウェア |

|---|---|---|---|---|---|

| GLM-4.7 | MoE Transformer ("深く、広くない"設計) | 約4,000億 (400B) | 約320億 (32B) | 202,752トークン | 不明 |

| GLM 5 | DeepSeek-V3/V3.2 MoE (DSA, MTP) | 7450億 (745B) | 約440億 (44B) | 202Kトークン | Huawei Ascend, MindSpore |

2. コンテキストウィンドウの拡張

GLM 5は、最大202Kトークンに対応する広範なコンテキストウィンドウを誇ります 10。これは、GLM-4.7の200,000トークンからわずかに拡張されたものであり、約300ページ(80万文字)の書籍に相当する情報を一度に処理できる能力を維持しています 5。これにより、より長大なドキュメントの理解や複雑なタスクの処理が可能になります。

3. 推論・コーディング・エージェント能力の統合と洗練

GLM 5は、特に推論、コーディング、エージェント能力において画期的な進歩を遂げたとされています 2。

- 「思考モード」のさらなる強化: GLM-4.7で導入された「思考モード」(Interleaved、Preserved、Turn-level)がGLM 5でさらに洗練されています 5。GLM 5は、指示がなくても思考プロセスを内部的に構築する能力や、自己批判的な調整を行う能力が強化されており、複雑なタスクにおけるハルシネーション(誤情報の発信)を抑制します 4。

- コーディング能力の向上: 完全な書き換えではなく、文脈を維持した増分的なコード編集をより適切に処理できるようになりました 4。また、UIの生成能力である「Vibe Coding」もGLM 4.7と比較して改善されています 12。GLM-4.7はSWE-benchで73.8%のスコアを達成し、オープンソースモデルとして最高峰の性能を示しましたが、GLM 5はこの基盤をさらに強化していると期待されます 5。

- エージェント能力の進化: エージェントタスクにおけるツール呼び出しの明確さ、必要な入力の特定、再試行の提案などが向上しています 4。これにより、GLM-4.7が示した高度なツール呼び出し能力をさらに発展させ、自律的に動作するAIエージェントの開発を一層容易にします 5。

4. マルチモーダル理解と生成の高度化

GLM 5は、Z.aiがこれまでに開発してきたGLM-4.5V(マルチモーダル推論)やGLM-Image(高精度画像生成・テキストレンダリング)といった特定の能力に特化したモデルのブレイクスルーを統合し、より汎用的かつシームレスなマルチモーダル理解と推論を実現することが期待されます 14。画像や動画の内容を直接「見て」理解するビジョン言語モデル(VLM)としての機能が強化され、多様なモダリティを直接的に扱えるようになるでしょう 14。

5. ハードウェア独立性の達成

GLM 5は、Huawei AscendチップとMindSporeフレームワークのみを用いてトレーニングされており、米国製ハードウェアに依存しない完全な独立性を達成している点が特徴です 11。これは、技術的な自立性を確保し、長期的な開発戦略におけるZhipu AIの重要なマイルストーンとなります 11。

6. 開発者・ユーザーへのメリット

GLMシリーズは、その費用対効果の高さ、オープンな姿勢(HuggingFaceやModelScopeでのモデルウェイト公開、ローカル実行可能性)、およびコーディング特化の機能により、開発者コミュニティから高い評価と期待が寄せられています 1。GLM 5も、これらのメリットを継承し、以下のような価値を提供します。

- 費用対効果: 前世代モデルと同様に、競合他社と比較して破壊的なコストパフォーマンスを提供する可能性が高いです 5。

- オープンな姿勢: (今後の発表で確認が必要ですが)モデルウェイトの公開やAPI経由での利用可能性を通じて、AI開発の民主化をさらに推進することが期待されます 1。

- 高度なAIエージェント開発: 強化された思考モードとエージェント能力により、複雑なタスクを自律的に実行できるAIエージェントの開発を強力に支援します 1。

7. 利用可能性と今後の情報公開

GLM 5は、リリース時点でchat.z.aiにて利用可能となっています 1。chat.z.aiのモデルセレクターでは「New」タグ付きで表示され、前世代のGLM-4.7は「Previous flagship model」と表記されています 1。GLM 5の技術的詳細やベンチマーク結果をまとめた公式ブログ記事、およびAPI経由での利用に関する詳細情報は、今後公開される予定です 1。

市場への影響と将来の展望

GLM 5の登場は、AI業界全体、そしてユーザーのAI体験に大きな変革をもたらす可能性を秘めています。Zhipu AIが目指す国際的な大手モデル企業への道のりにおいて、GLM 5は戦略的に重要な一歩と位置づけられています3。

業界とユーザーへの影響:AI体験の再定義とAGIへの貢献

GLM 5は、AIの使い方を再定義する可能性を秘めており、特にインテリジェントなライティングやコード生成分野での実質的な向上が期待されます2。Zhipu AIは、新しいモデルアーキテクチャの設計、より汎用的な強化学習の探求、オンライン学習や継続学習といった持続的学習と自律的進化への道を開くことで、AGI(汎用人工知能)の技術高地を追求するための重要な基盤を築くことを目指しています3。この取り組みは、将来的にはAIがより自律的に複雑な問題解決を行う汎用的なアシスタントとなる可能性を示唆しています。

市場の反応と競合との比較:費用対効果とオープン戦略の優位性

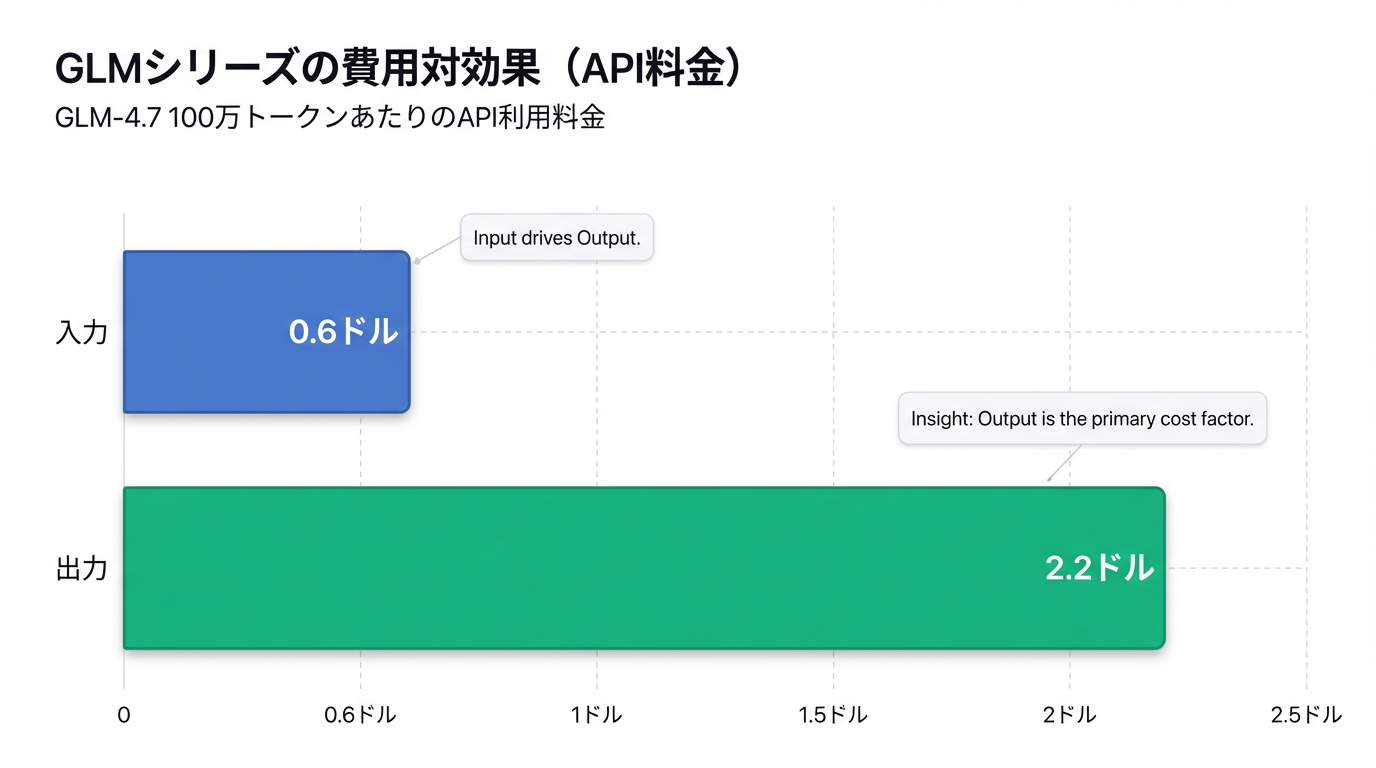

GLMシリーズは、その費用対効果の高さ、オープンな姿勢、およびコーディング特化の機能により、開発者コミュニティから高い評価と期待が寄せられています1。特に、GLM-4.7で打ち出された「GLM Coding Plan」の月額3ドルという破格のサブスクリプション料金は、GPT-5.1やClaude 4.5に匹敵するか、それ以上の利用枠をはるかに低コストで提供しており、競合に対して圧倒的な費用対効果を誇ります。API利用料金も、100万トークンあたり入力0.60ドル、出力2.20ドル程度と、競合他社の数分の一に設定されています5。GLM 5(Pony Alpha)の出力スタイルはClaude Opusに似ており、論理的で詳細であると評価されており、性能面でも主要なモデルと肩を並べる水準に達しています17。

戦略的意義:オープンソースによる開発の民主化

Zhipu AIの戦略における重要な柱の一つが、オープンソース戦略です。GLMシリーズは、モデルウェイトが公開されている「オープンウェイト」モデルとして提供されており、これにより高価なサブスクリプションを支払えない小規模チームや、機密保持が最優先される企業でも、世界最高峰のAIを利用した開発が可能となります。これは、AI開発の民主化を促進し、ローカル環境でのデプロイメントの柔軟性を提供することで、技術エコシステムの構築を支援します。MITライセンスの下でのオープンソース公開は、クローズドソースモデルが支配する市場への挑戦であり、世界中の開発者の力を借りてイノベーションを加速させるという戦略的な動きでもあります。

ハードウェア独立性の重要性

GLM 5は、Huawei AscendチップとMindSporeフレームワークのみを用いてトレーニングされており、米国製ハードウェアに依存しない完全な独立性を達成している点が大きな特徴です11。このハードウェア独立性は、技術的な自立性を確保し、長期的な開発戦略における重要な要素であり、地政学的なリスクが伴う現代において、特にその意義が大きいと言えます11。

将来の展望とロードマップ:マルチモーダル統合とエージェント知能の進化

GLM 5は、既存のGLMシリーズの強みを発展させつつ、より大規模なMoEアーキテクチャ、革新的なトレーニング方法、そしてハードウェアの独立性を通じて、AIエージェントと複雑なタスク解決の分野で次のフロンティアを切り開くことを目指しています11。これまでのGLMシリーズの進化と、GLM-4.7およびGLM-4.5V、GLM-Imageといった特化モデルの技術的ブレイクスルーを踏まえると、GLM-5は以下のような方向性で発展すると推測されます。

- 統合されたマルチモーダル理解と生成: GLM-4.5VやGLM-Imageで見られる視覚・画像・テキスト理解能力が、より汎用的かつシームレスに統合され、真に多様なモダリティを直接的に扱えるようになるでしょう。

- 高度なエージェントインテリジェンス: GLM-4.7の「思考モード」がさらに洗練され、より複雑で長期的なタスクを自律的かつ高い信頼性で実行できるようになる可能性があります18。これは、人間のように道具を使いこなし、計画立案や自己修正を行う能力の強化を意味します。

- 効率性とスケーラビリティのさらなる追求: MoEアーキテクチャやTransformerとMambaの組み合わせのようなハイブリッドアーキテクチャの進化により、より少ない計算リソースで高性能を維持、あるいは向上させることが期待されます19。

- 深層推論能力の強化: 数学、科学、論理パズルなどの複雑な問題に対する推論能力が、より深い階層構造と効果的な学習プロセスによって向上するでしょう。

- 多様な環境への適応: ローカルデプロイメントの要件に応じた、さらに軽量で高効率なモデルバリエーションの提供や、Huawei AscendのようなNVIDIA以外のハードウェアでの最適化が継続されるでしょう20。

結論

GLM 5は、2026年2月11日早朝にZhipu AI (Z.ai) によって正式にリリースされた、大規模言語モデルGLMシリーズの最新フラッグシップモデルです 1。このモデルは、チャット、コーディング、エージェントタスクに特化して最適化されており、前世代のGLM-4.7から大幅な性能向上と新しい技術的改善が施されています 1。特に、DeepSeek-V3/V3.2アーキテクチャ、DeepSeek稀疏注意力(DSA)とMulti-Token Prediction(MTP)技術の導入により、総パラメータ数7,450億(745B)、アクティブパラメータ数440億という大規模なMoE(混合専門家)構造を実現しています 10。また、最高202Kトークンのコンテキストウィンドウに対応し、複雑なタスク処理能力を飛躍的に高めています 10。

Zhipu AIはGLM 5を通じて、「AI使用体験の再定義」2と「国際的な大手モデル企業となる」という2026年の戦略目標の達成を目指しています 3。これは、AGI(汎用人工知能)の技術高地を追求するための重要な基盤であり、新しいモデルアーキテクチャの設計、より汎用的な強化学習の探求、そしてオンライン学習や継続学習による自律的進化への道を開くことを目的としています 3。

GLM 5は、推論、コーディング、エージェント能力の統合的な進化を通じて、AIの未来に大きな影響を与えることが期待されます。GLM-4.7で導入された「思考モード」がさらに洗練され、複雑な推論タスクにおいて自己批判的な調整を可能にし 4、コーディングにおいては文脈を維持した増分的な編集をより適切に処理できます 4。エージェント能力も向上し、ツール呼び出しの明確さや再試行の提案が強化されています 4。これらの進歩は、AIエージェントがより自律的に、かつ高い信頼性で複雑なタスクを実行するための道を切り開きます。

さらに、Huawei AscendチップとMindSporeフレームワークのみでトレーニングされたことは、米国製ハードウェアに依存しない完全な独立性を達成している点で特筆すべきであり 11、技術的な自立と戦略的なオープンソース化(MITライセンス)7は、開発の民主化を促進し、世界中の開発者コミュニティに多大なメリットをもたらすでしょう。GLM 5は、その強力なアーキテクチャと広範な機能により、将来のAIアプリケーション開発とAI利用体験の変革において中心的な役割を果たすと期待されます。