MiniMax-M2.5、ついに登場!画期的なAIエージェントが未来を拓く

はじめに:MiniMax-M2.5とは?

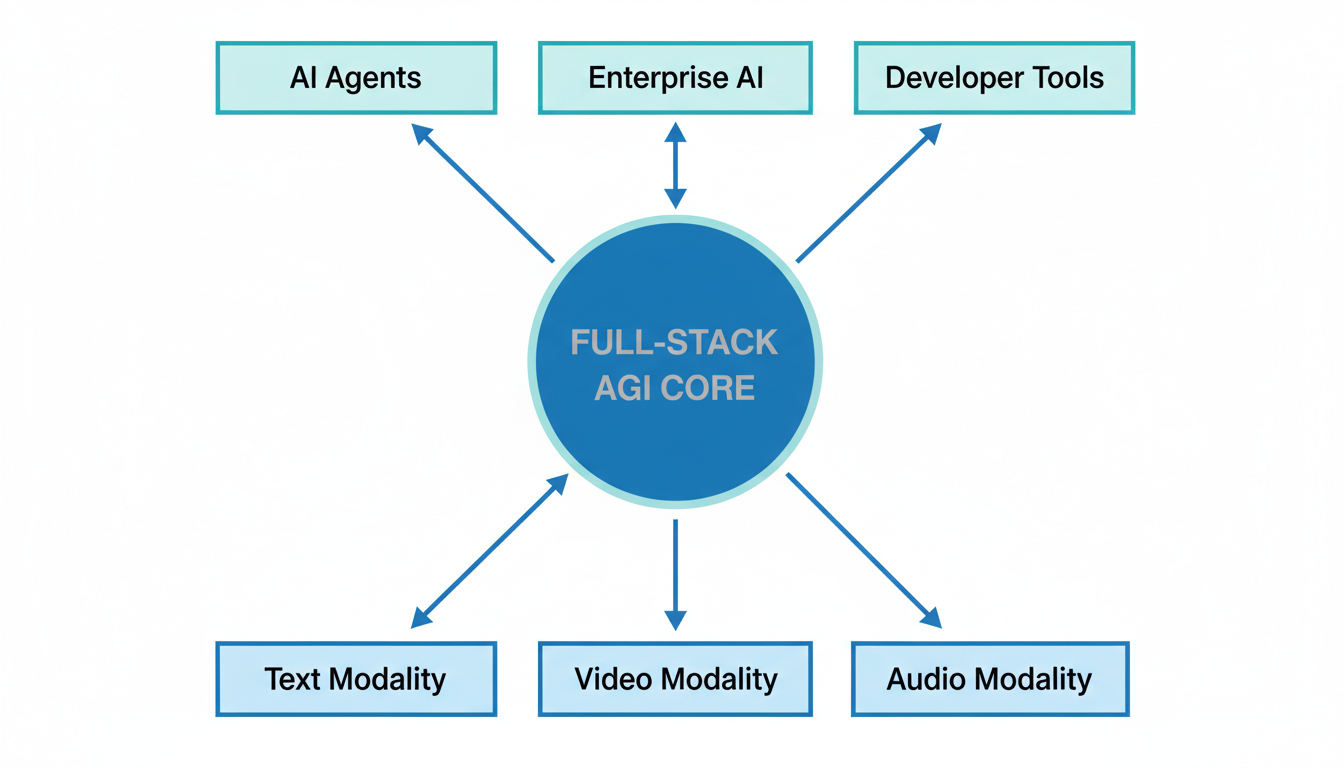

2026年2月11日、中国のAI企業MiniMaxは、最新の大規模言語モデル(LLM)であるMiniMax-M2.5を正式に発表しました1。このモデルは、MiniMaxが提供するフルスタックAIモデル群の中核をなす汎用テキスト推論モデルとして位置づけられており、特にAIエージェントとしての活用に特化しています1。MiniMax-M2.5の登場は、AI技術の民主化と技術普及を推進する重要な一歩となります1。

MiniMax-M2.5は、前バージョンMiniMax-M2.1からの主要な強化点として、AIエージェント機能の強化、マルチモーダル対応の深化、およびコーディングやオフィス業務などの実用タスクへのさらなる最適化が挙げられます1。これにより、MiniMaxはグローバル市場での競争力を高め、スマートエージェント分野での技術的優位性を確立することを目指しています2。

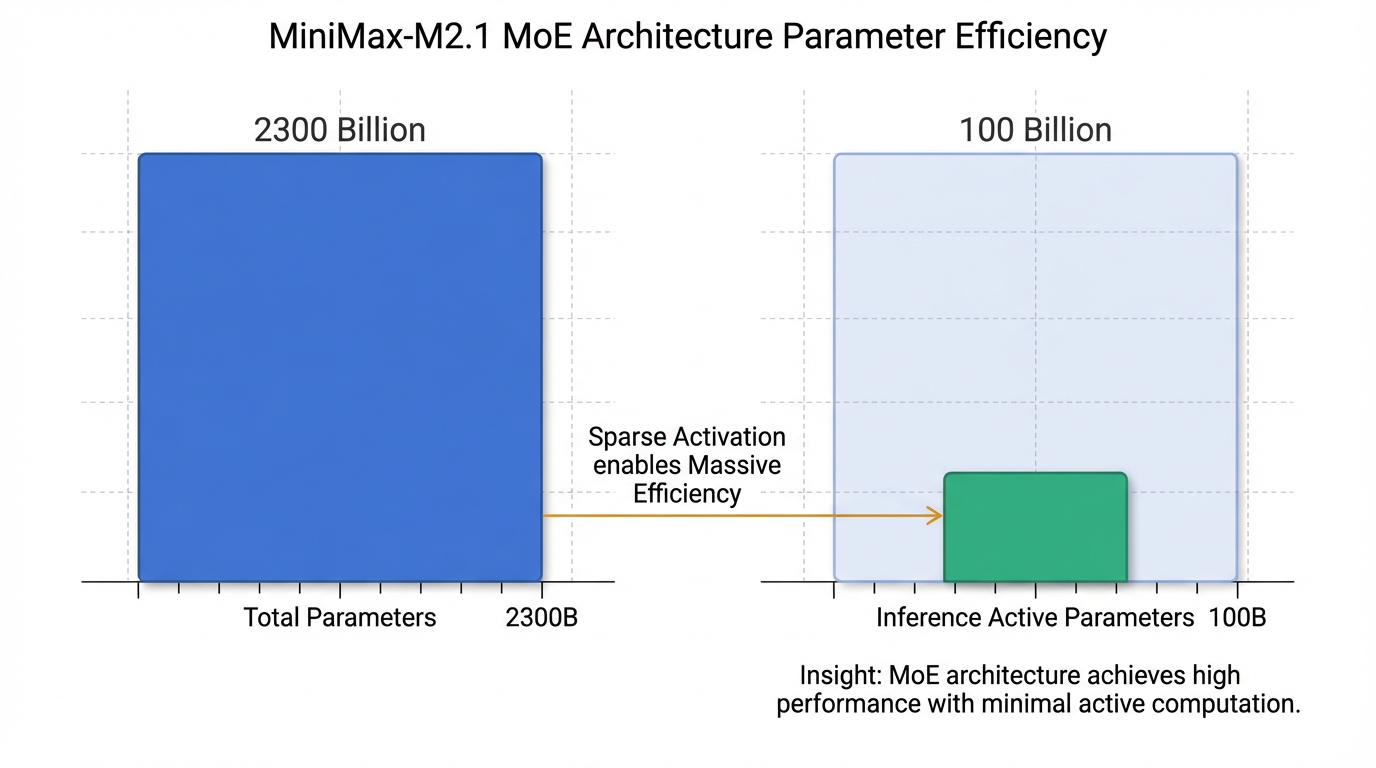

MiniMax-M2.5の基盤であるMiniMax-M2.1は、Mixture-of-Experts (MoE) アーキテクチャを採用している点が特徴です。この設計により、総パラメータ数2300億にもかかわらず、推論時にアクティブになるのはわずか100億パラメータに抑えられています3。この効率的なアプローチは、中規模LLMのフットプリントで最上位モデルに近い知能を実現し、高い効率性と費用対効果を提供します3。

さらに、MiniMax-M2.5は400kトークンという広範なコンテキストウィンドウを誇り、複雑な長文の理解と生成を可能にします3。多言語・多機能対応も強化されており、Pythonだけでなく、Rust、Java、Golang、C++、Kotlin、Objective-C、TypeScript、JavaScriptなど多様なプログラミング言語に対応し、Web/アプリ開発能力も向上しています3。また、「インターリーブ思考」アーキテクチャの導入により、複合的な指示に対する問題解決能力、応答の簡潔性、およびWebコンテンツ解析やコマンド操作などのデジタル従業員機能が実現されています3。

MiniMax-M2.5のリリースは、AI技術の利用障壁を大幅に引き下げ、AIの民主化を促進する可能性を秘めています3。その高性能と費用対効果は、AI業界がクローズドソースの独占からオープンソースの協力へと転換する歴史的な契機となることが期待されています3。

主要な機能と特徴

2026年2月11日に発表されたMiniMax-M2.5は、AIエージェントとしての活用に特化しており、先行するM2およびM2.1モデルからさらに進化した機能強化とパフォーマンス向上を実現しています1。MiniMaxの「フルスタック型」AIモデル戦略の中核を担うこのモデルは、ユーザーに以下の主要な機能とメリットを提供します。

AIエージェントに特化した設計

MiniMax-M2.5は、AIエージェントとしての利用を主眼に設計されており、複雑なツール呼び出し、タスクの計画と実行、継続的な推論ループを通じてビジネスプロセスを自動化する能力を強化しています1。M2.1の基盤を継承し、多様なツールチェーン(Shell、ブラウザ、Pythonインタープリタ、MCPツールなど)を連携させて複雑なタスクを計画・実行することが可能です4。

「デジタル従業員」機能の進化

Webコンテンツの解析やテキストコマンドによるマウス・キーボード操作を通じて、管理、データサイエンス、金融、人事、ソフトウェア開発といった多岐にわたるオフィス業務をエンドツーエンドで遂行できる「デジタル従業員」機能が大幅に強化されています3。これにより、業務の自動化と効率化が飛躍的に進展します。

高度なコーディング能力

M2.1の技術的枠組みを継承し、Pythonに加えRust、Java、Golang、C++、Kotlin、Objective-C、TypeScript、JavaScriptなど、多様なプログラミング言語に対応しています3。コード生成、実行、デバッグ、検証、自動修正を含むエンドツーエンドの開発ワークフローをサポートし5、Web/アプリ開発能力も大きく向上しています3。

「インターリーブ思考」アーキテクチャの導入

MiniMax-M2.1で導入された「インターリーブ思考」アーキテクチャがM2.5にも採用されており、複合的な命令制約下でのシステム的問題解決能力が大幅に向上しています3。これにより、より簡潔で効率的な応答生成が可能となり、エージェント機能の精度と信頼性を高めています3。

Mixture-of-Experts (MoE) アーキテクチャによる効率性

MiniMax-M2.5は、M2.1が採用しているMixture-of-Experts (MoE) アーキテクチャを引き継いでいます。総パラメータ数は2300億に達するものの、推論時にアクティブになるのはわずか100億パラメータに抑えられており3、中規模LLMのフットプリントで最上位モデルに近い知能を実現します3。この効率的な設計は、高い費用対効果を提供します3。

広範なコンテキストウィンドウ

M2.1の大容量コンテキストウィンドウである400Kトークンを継承しており3、これにより複雑な長文の理解と生成能力が強化され、多様なタスクにおける対応能力が向上しています3。

圧倒的なコストパフォーマンスと速度

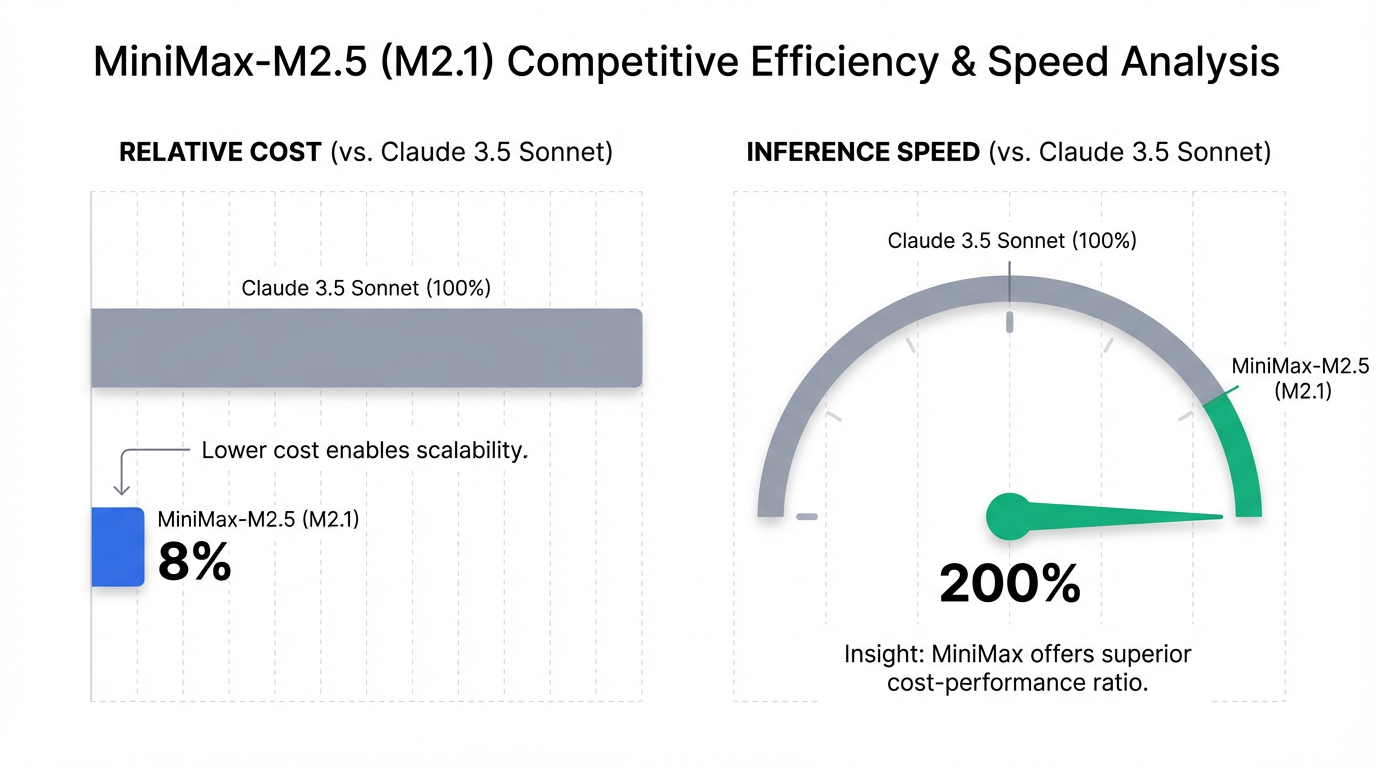

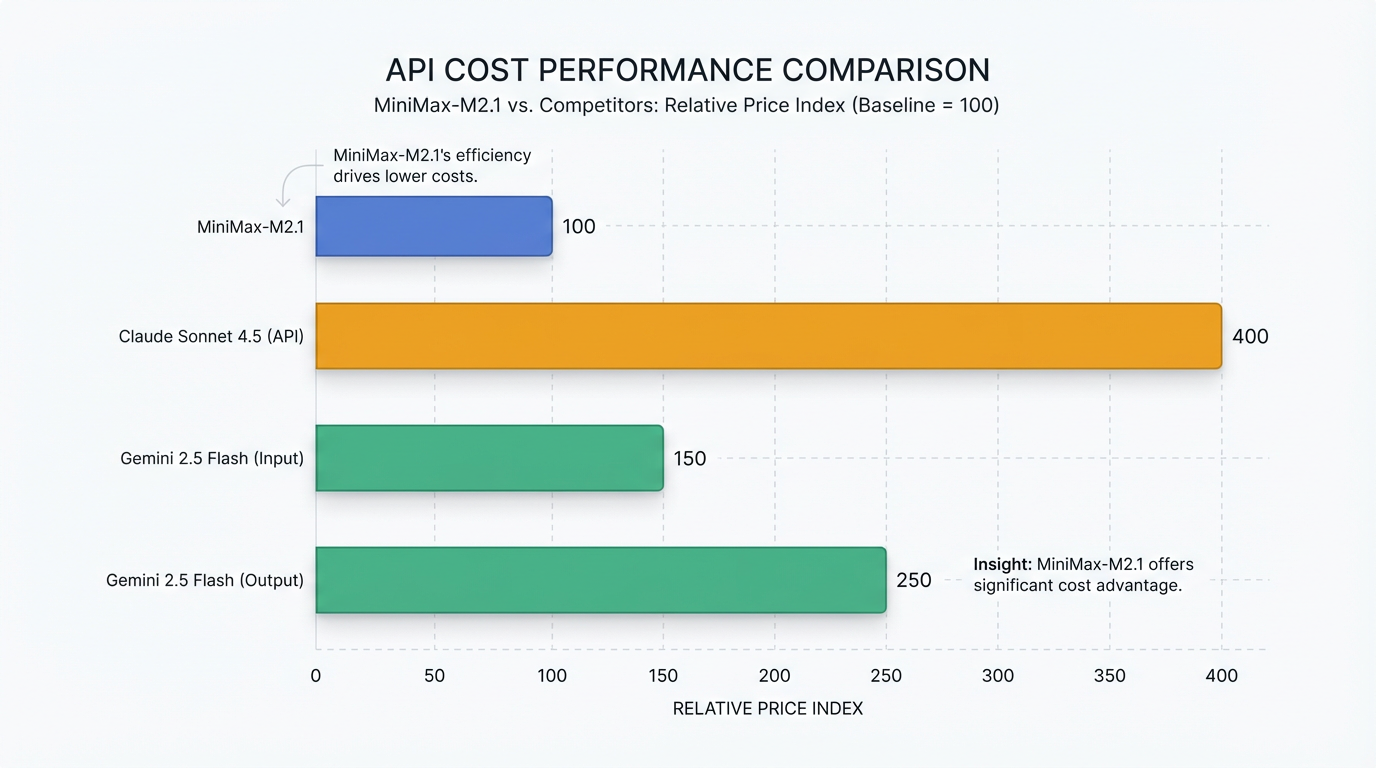

MiniMax-M2.5のAPI価格は、競合モデルと比較して約8%に抑えられており、推論速度は2倍高速であると報告されています。これにより、運用コストの大幅な削減と業務効率の劇的な向上に貢献します6。API利用料は入力トークン100万個あたり0.3ドル、出力トークン100万個あたり1.2ドルという低価格を実現しています7。

M2.1のベンチマーク性能からの進化

MiniMax-M2.5の基盤であるM2.1は、主要なソフトウェアエンジニアリングのリーダーボードでM2を大幅に上回る性能を示し3、多言語シナリオではClaude Sonnet 4.5を凌駕し、Claude Opus 4.5に迫る性能を発揮しています3。VIBE (Visual & Interactive Benchmark for Execution) の総合ベンチマークでは平均88.6%の優れたパフォーマンスを達成し、特にWeb(91.5%)およびAndroid(89.7%)タスクに強みを見せています3。MiniMax-M2.5は、これらの実績をさらに発展させることが期待されています1。

業界への影響と期待

MiniMax-M2.5の主要ターゲット市場と業界

MiniMaxが開発した最新のフラッグシップ大規模言語モデル(LLM)であるMiniMax-M2.5は、特に自律型AI(エージェント)の活用を前提に設計されており 8、以下の市場と業界を主要なターゲットとしています。

- 開発ツールおよびソフトウェアエンジニアリング: プログラミング能力とエージェント性能が求められるこの市場において、PC、モバイルアプリ、マルチプラットフォーム環境でのフルスタック開発を総合的に支援します 8。MiniMax-M2.1ではPythonだけでなくRust、Java、Golang、C++、Kotlin、Objective-C、TypeScript、JavaScriptなど多様なプログラミング言語に対応し、Web/アプリ開発能力(Android、iOS開発を含む)が強化されています 。

- 企業AIおよびビジネス自動化: Excelの高度なデータ処理、詳細な調査業務、PowerPoint資料作成など、オフィスソフトを活用した中核的な生産性向上分野での活用を想定しています 8。MiniMax-M2.1は、Webコンテンツをテキスト形式で受け入れ、テキストベースのコマンドを介してマウス操作やキーボード入力を制御し、管理、データサイエンス、金融、人事、ソフトウェア開発などの日常的なオフィスシナリオでエンドツーエンドのタスクを完了できる「デジタル従業員機能」も備えています 3。

- スタートアップ企業: MiniMax-M2のAPIコストは競合モデルより大幅に低く、推論速度も高速であるため、予算が限られたスタートアップ企業が大規模なアプリケーションを運用する際にコスト効率と速度のメリットを享受できます 。

- 研究開発コミュニティ: MiniMax-M2およびMiniMax-M2.1はオープンソースとして公開されているため、研究機関や開発チームがモデルウェイトをダウンロードして、独自の研究、カスタムファインチューニング、および特定用途への展開を行うことが可能です 。

競合モデルとの比較における位置付け

MiniMax-M2.5は、高性能化が進むAIモデル市場において、特に「プログラミング能力」と「エージェント性能」の両面で国際的な最先端モデルに匹敵する実力を目指し、Anthropic社の「Claude Opus 4.6」を明確な競合として意識しています 8。

MiniMax-M2.5はMixture-of-Experts (MoE) 方式を採用しており、総パラメータ数が膨大であるにもかかわらず、推論時にアクティブになるパラメータはわずか約100億に抑えられています 8。これにより、高い知能を維持しつつ、GPUメモリ使用量や推論時のエネルギー効率に優位性を持っています 8。前モデルのMiniMax-M2は4枚のH100 GPUで動作し、前世代(MiniMax-M1)より推論速度を約2倍向上させています 9。

性能比較

- プログラミング: MiniMax-M2.5はOpenCodeベンチマークで89.3%のスコアを記録しています 10。MiniMax-M2.1はSWE-bench Verifiedで74.0%を達成しており、Claude Sonnet 4.5に匹敵するとされます 11。また、多言語プログラミング(非Python言語)ではClaude Sonnet 4.5を上回り、Claude Opus 4.5に近づく性能を示しています 11。競合としては、GLM-5がOpenCodeで94.7%、SWE-bench Verifiedで77.8%とより高いスコアを記録しています 。GPT-5.1はSWE-bench Verifiedで76.3% 9、GPT-5.2は80% 11、Claude Opus 4.5は80.9% です。

- エージェント性能: MiniMax-M2.5はエージェント機能において高い性能を誇り 8、MiniMax-M2はτ²-Benchで77.2、BrowseCompで44.0、FinSearchCompで65.5といった高いスコアを示しており、「ツールの利用と深い検索能力は海外トップモデルに迫る」と評価されています 9。競合ではKimi K2 ThinkingがBrowseCompで60.2% 9、GLM-5はBrowseCompで62.0%とTerminal-Bench 2.0で56.2%を記録し、MiniMax-M2.5を上回る結果を出しています 12。

- 総合知能: MiniMax-M2はArtificial AnalysisのIntelligenceベンチマークで世界トップ5にランクインし、Gemini 2.5 ProやClaude 4.1 Opusを上回る評価を得ています 。MiniMax-M2.1は一部テストでGemini 3 ProやGPT-5.2を超えるスコアを記録しています 13。

コストと速度

MiniMax-M2のAPI価格は入力100万トークンあたり$0.30、出力100万トークンあたり$1.20であり、Claude Sonnet 4.5の約8%の価格で提供され、推論速度はClaude Sonnetの約2倍と報告されています 。MiniMax-M2.1のAPI価格はOpenRouter経由で入力100万トークンあたり$0.12、出力100万トークンあたり$0.48とさらに低価格化しており、Claude Sonnet 4.5より約75%安価です 11。これはMiniMaxモデル群の大きな差別化要因です。

コンテキストウィンドウ

MiniMax-M2は入力約204.8kトークン、出力131.1kトークンに対応し 9、MiniMax-M2.1は400kトークンと報告されています 3。これはGPT-5.1の合計400kトークン(入力272k + 出力128k) 9やKimi K2 Thinkingの256kトークン 9に匹敵する、または上回る長さです。

主要LLMモデル比較

| モデル名 | プログラミングベンチマーク | エージェント性能ベンチマーク | APIコスト (入力/出力 1Mトークン) | 推論速度 (TPS) | コンテキストウィンドウ (トークン) |

|---|---|---|---|---|---|

| MiniMax-M2.5 | OpenCode: 89.3% | 高機能 | N/A | N/A | N/A |

| MiniMax-M2.1 | SWE-bench Verified: 74.0%, 多言語プログラミングでClaude Sonnet 4.5を上回る | N/A | 入力 $0.12 / 出力 $0.48 | N/A | 400k |

| MiniMax-M2 | N/A | τ²-Bench: 77.2, BrowseComp: 44.0, FinSearchComp: 65.5 | 入力 $0.30 / 出力 $1.20 | 約100 | 入力 204.8k / 出力 131.1k |

| Claude Sonnet 4.5 | SWE-bench Verified: M2.1 (74.0%)に匹敵 | N/A | N/A | 約50 (M2の約半分) | N/A |

| Claude Opus 4.5 | SWE-bench Verified: 80.9%, 多言語プログラミングでM2.1に迫る | N/A | N/A | N/A | N/A |

| GLM-5 | OpenCode: 94.7%, SWE-bench Verified: 77.8% | BrowseComp: 62.0%, Terminal-Bench 2.0: 56.2% | N/A | N/A | N/A |

| GPT-5.1 | SWE-bench Verified: 76.3% | N/A | N/A | N/A | 400k (入力 272k + 出力 128k) |

| GPT-5.2 | SWE-bench Verified: 80% | N/A | N/A | N/A | N/A |

| Kimi K2 Thinking | N/A | BrowseComp: 60.2% | N/A | 約37 (M2の約1/2.7) | 256k |

新技術が特定の業界にもたらす影響

MiniMax-M2.5の登場は、特に以下の業界に大きな影響を与えると予想されます。

- 企業AI: 複合命令制約の強化とデジタル従業員機能により、管理、データサイエンス、金融、人事などのバックオフィス業務の自動化を加速させ、従業員の生産性を大幅に向上させます 3。MiniMax-M2.5はExcelの高度なデータ処理やPowerPoint資料作成を支援し 8、手作業で数時間から数日かかっていたタスクを数分に短縮する可能性を秘めています 14。

- 開発ツール: 開発者のワークフローにおけるパラダイムシフトを意味します 15。AIがコードの記述、実行、デバッグ、テスト、修正のサイクルを自律的に行えるようになるため、人間の開発者はより上流の、創造的で戦略的な業務(問題定義、アーキテクチャ設計、AIエージェントの管理)に集中できるようになります 15。これにより、ソフトウェア開発の生産性と品質が飛躍的に向上することが期待されます 15。

- 自動化: エージェント機能の強化により、複雑な多段階タスクの自動化が容易になります 。Webブラウジング、ターミナル操作、API呼び出し、データベース操作などを含む幅広いシナリオで、AIが自律的に目標を達成する能力が高まります 。

競合他社に対するMiniMax-M2.5の具体的な強みと差別化要因

MiniMax-M2.5とその前身モデル(MiniMax-M2、MiniMax-M2.1)は、競合モデルに対して以下の点で差別化されています。

- 優れたコストパフォーマンス:

- 高速な推論速度:

- エージェントおよびコーディングワークフローに特化:

- コード生成、デバッグ、修正、テスト検証、Webブラウジング、ツール呼び出しなど、エンドツーエンドの開発ワークフローに最適化されています 。MiniMax-M2.1では多言語プログラミングの卓越性も実現し、Python以外の言語でも業界をリードするパフォーマンスを発揮します 。

- 複雑な長鎖計画の実行、複数のツールの安定した利用、エラー回復能力に優れています 。

- オープンソース戦略:

- MiniMax-M2およびMiniMax-M2.1のモデルウェイトがMITライセンス下で公開されており、商用利用が可能です 。これにより、開発者はベンダーロックインを回避し、自社のインフラストラクチャでの展開、ファインチューニング、およびカスタマイズの自由度が高まります 。

- 強力なコンテキストウィンドウ:

今後の展望とまとめ

MiniMax-M2.5は、高性能、比類ないコスト効率、そしてAIエージェント機能に特化した設計により、AI業界に新たな基準を打ち立てるモデルです。総パラメータ数2300億ながら推論時に活性化するのはわずか100億パラメータというMixture-of-Experts (MoE) アーキテクチャ3と、競合モデルの約2倍高速な推論速度を両立し、費用対効果の高さは競合の約8%から75%安価という驚異的なレベルに達しています。特に、複雑なツール呼び出し、コーディング、オフィス業務の自動化といったエージェント関連タスクにおいて、顕著な能力を発揮します。

MiniMax社は、テキスト、音声、動画、音楽を網羅する「フルスタックAIモデル群」1を基盤とし、「フルスタックAGI(汎用人工知能)」の実現をビジョンとして掲げています15。M2.5のリリースは、AI技術の利用障壁を大幅に引き下げ、AIの民主化を加速させる画期的な一歩です。その高性能と費用対効果は、AI業界が「クローズドソースの独占」から「オープンソースの協力」へと転換する歴史的な契機となる可能性を秘めています3。MiniMax-M2.5は、グローバルなAIアプリケーション市場での競争力を高め、スマートエージェント分野における技術的優位性を確立しようとしています。これにより、開発者のワークフローにパラダイムシフトをもたらし、ソフトウェア開発の生産性と品質を飛躍的に向上させることが期待されます15。

しかし、MiniMax-M2.5にはいくつかの課題も残されています。日本語生成能力においては、日本語入力時に中国語や英語が混じるという問題が指摘されており、今後の改善が期待されます。また、一部の競合モデルと比較して多弁性が見られ、同じタスクを完了するためにより多くのトークンを使用する傾向があるため、見かけの低価格にもかかわらず実際のコストが増加する可能性もあります18。マルチモーダル機能はテキストベースのタスクに特化しており、画像生成や動画理解といった高度なマルチモーダル推論能力は、トップクラスのプロプライエタリモデルと比較して限定的であるという点も今後の強化ポイントとなるでしょう。純粋な数学的推論能力も、専門モデルにはまだ及ばないという評価もあります11。

これらの課題がある一方で、MiniMax-M2.5は、その圧倒的なコストパフォーマンス、高速な推論速度、そしてエージェント機能に特化した強みにより、特にスモールビジネスやスタートアップ企業、開発者にとって、AI導入を検討する上で非常に有力な選択肢であることに変わりはありません。MITライセンス下でのオープンソース戦略は、ベンダーロックインを回避し、自社インフラでの展開やカスタマイズの自由度を高め、開発の柔軟性を提供します。MiniMax社は、今後もこれらの課題に対処しつつ、モデルの進化を継続すると予想されており15、その将来性は非常に大きいと言えるでしょう。AIの導入を検討されている皆様にとって、MiniMax-M2.5は、高性能とコスト効率のバランス、そしてエージェント駆動型AIの可能性を最大限に引き出すための強力なツールとなるでしょう。