GPT 5.3 Codex Sparkに関する詳細分析と最新情報

はじめに

ユーザー様より「GPT 5.3 Codex Spark」の正式リリースに関するお問い合わせをいただきました。本稿は、この情報の真偽を確認し、もし存在するのであれば、そのモデルの機能強化や特に印象的な側面について調査し、報告することを目的とします。

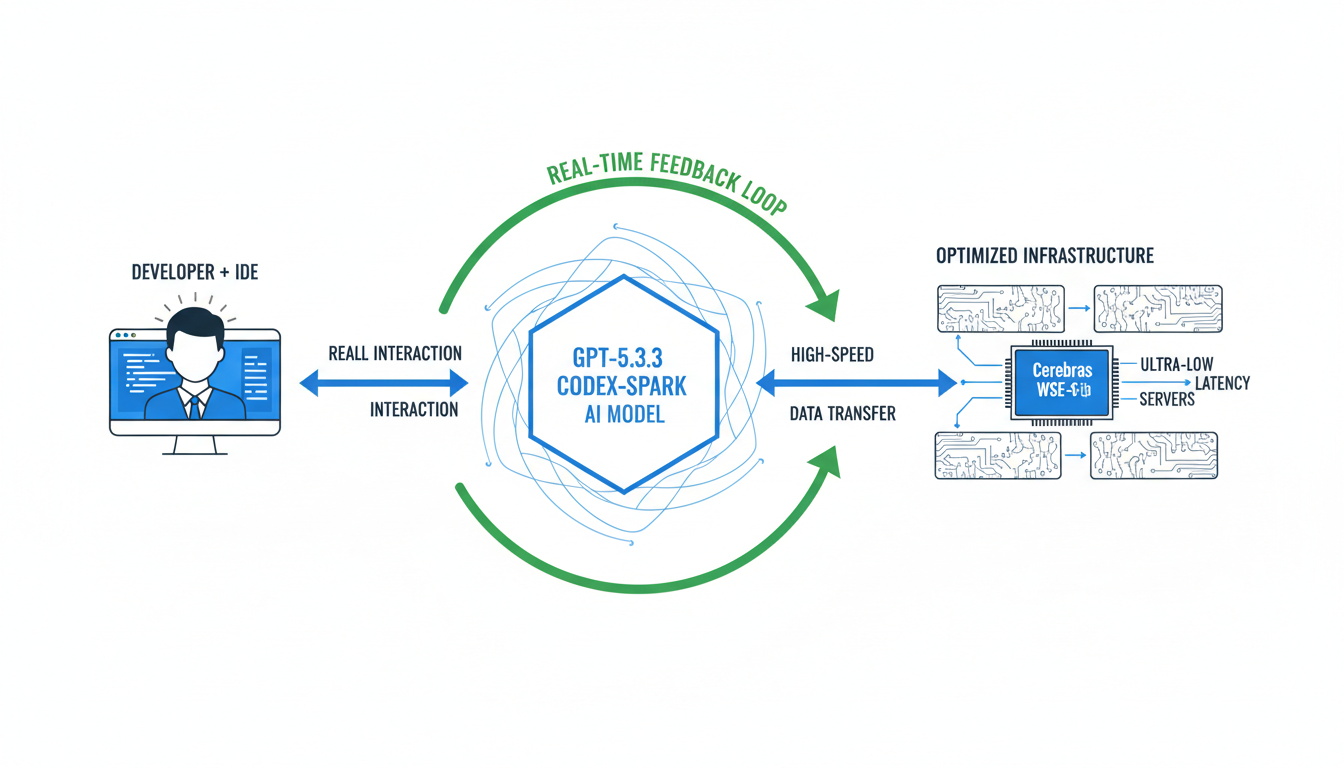

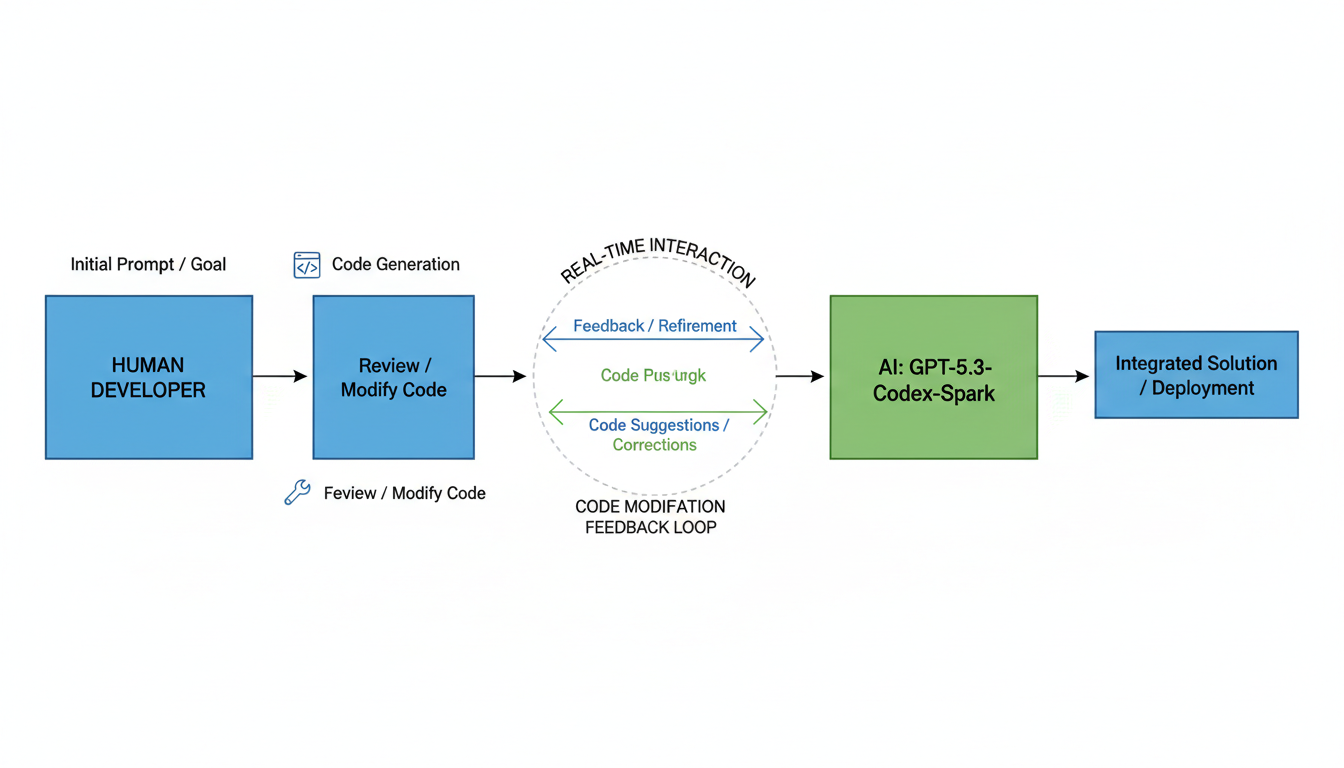

調査の結果、「GPT-5.3-Codex-Spark」という名称のAIモデルがOpenAIによって公式に発表され、リリースされていることが確認されました1。本モデルは、GPT-5.3-Codexの小型版として位置づけられ、リアルタイムでの対話的なコーディング作業に最適化されており、その圧倒的な速度とリアルタイム性が主要な特徴として挙げられます1。

本レポートでは、この「GPT-5.3-Codex-Spark」モデルの存在を確定した上で、そのリリース時期、発表元、主要な機能概要、そして類似する最新のGPTモデルやコード生成特化型AIモデルとの関連について詳細に記述します。

「GPT 5.3 Codex Spark」のリリース状況確認

ユーザー様からのお問い合わせに基づき、OpenAIが「GPT-5.3-Codex-Spark」を公式に発表・リリースしたことを確認いたしました。このモデルは、既存の「GPT-5.3-Codex」の小型版として位置づけられ、特にリアルタイムでの対話的なコーディング作業に特化している点が大きな特徴です1。

主要な特徴は以下の通りです。

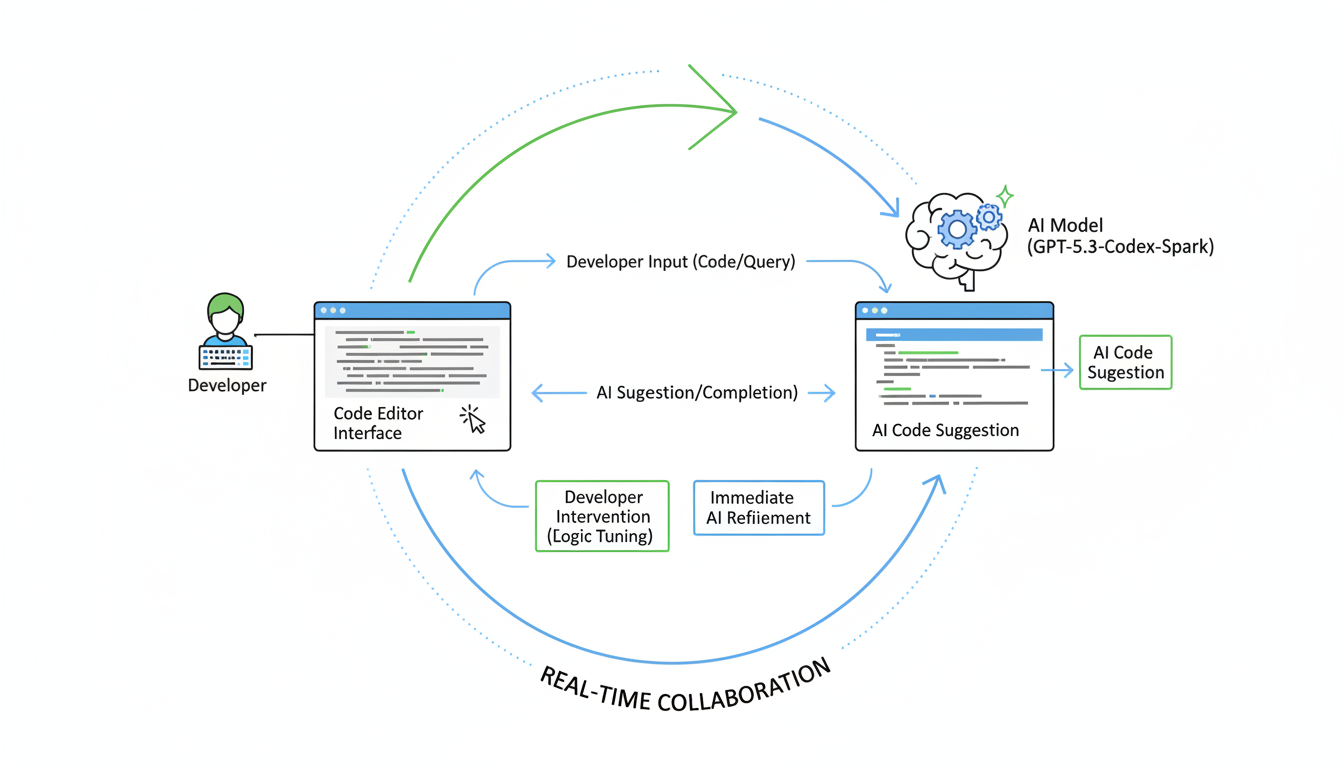

- リアルタイムコーディング特化: リアルタイムでの対話型コーディングに最適化されており、開発者の作業フローにシームレスに統合されます2。

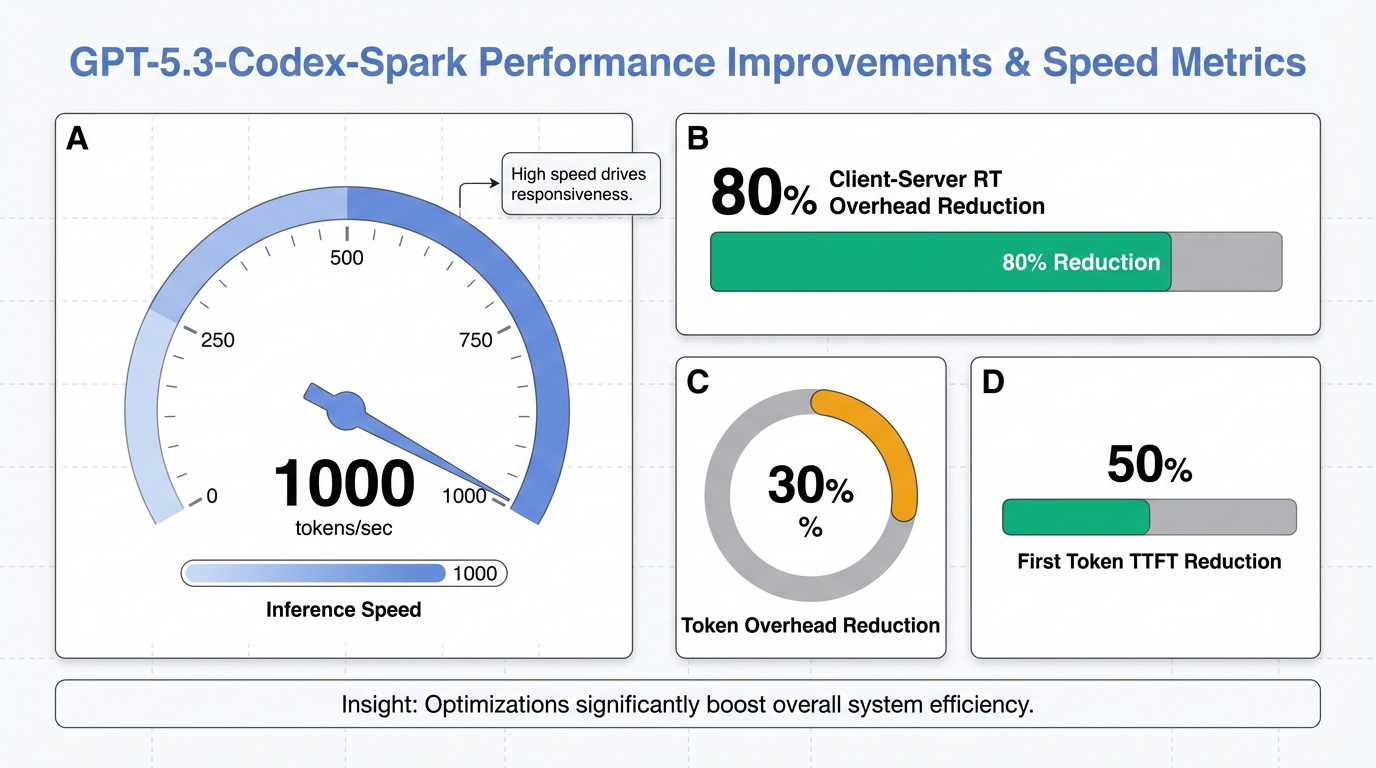

- 超高速推論: Cerebras Systemsの専用チップ「Wafer Scale Engine 3 (WSE-3)」上で動作し、1秒あたり1,000トークン以上の超高速推論を実現します1。これはOpenAIとCerebrasの提携による成果です1。

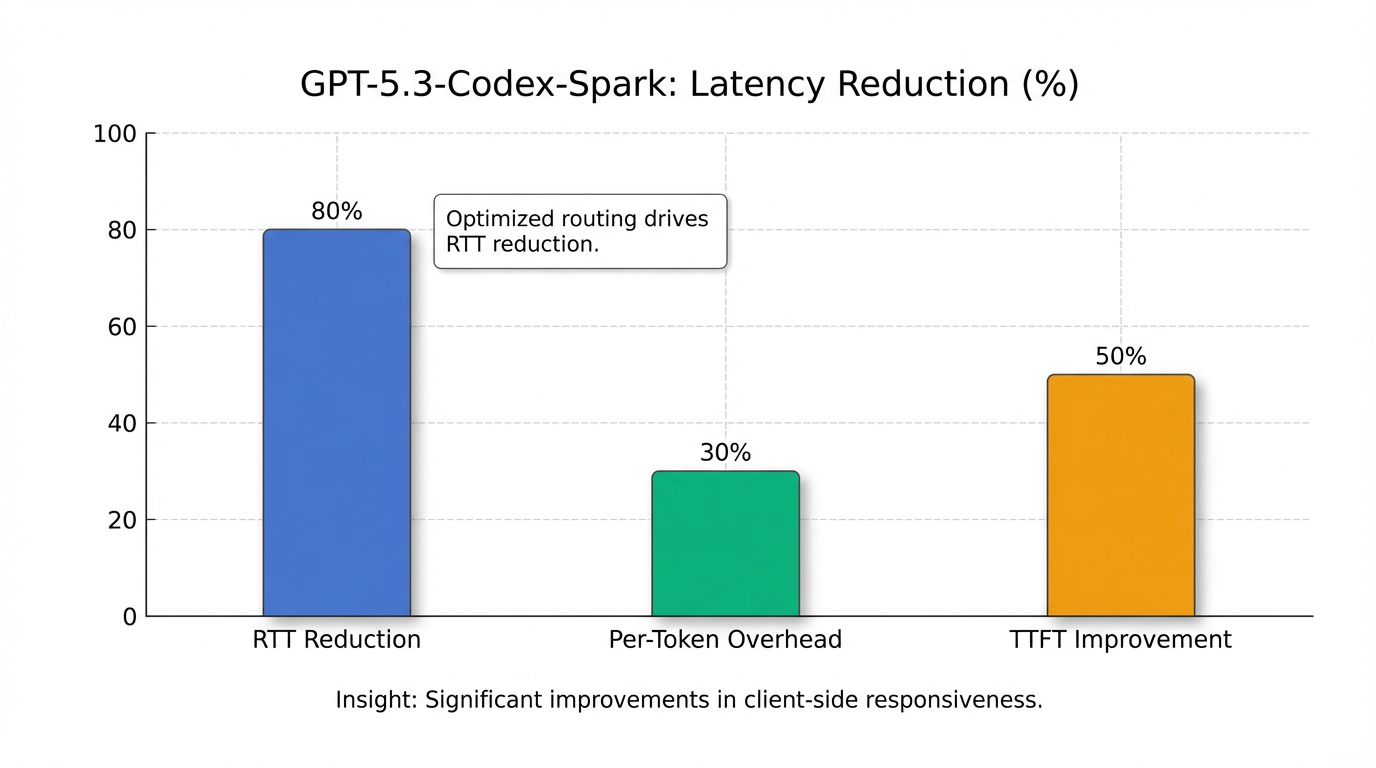

- 低遅延: インフラの最適化により、エンドツーエンドのレイテンシーを大幅に削減しています。具体的には、クライアント・サーバー間のラウンドトリップオーバーヘッドを80%削減、トークンあたりのオーバーヘッドを30%削減、そして最初のトークン表示までの時間(Time-To-First-Token)を50%短縮しています4。

- リアルタイムでの協調作業: 開発者がモデルの作業中に介入し、ターゲットを絞った編集、ロジックの微調整、インターフェースの洗練を即座に行うことが可能です2。

これらの機能により、開発プロセスにおけるAIとのインタラクションが飛躍的に向上することが期待されます。

「GPT-5.3-Codex-Spark」は、ChatGPT Proユーザー向けにリサーチプレビューとして提供されており、Codexアプリ、CLI、VS Code拡張機能を通じて利用できます2。

以下のグラフは、GPT-5.3-Codex-Sparkが示すパフォーマンス特性(速度と精度)のトレードオフを示しています。

このモデルは、SWE-Bench ProやTerminal-Bench 2.0などのベンチマークにおいて、GPT-5.1-Codex-miniよりも高速かつ高精度な応答を示していますが、GPT-5.3-Codexと比較すると精度は劣るものの、タスク完了速度が大幅に速いという「速度と精度のトレードオフ」が特徴となっています1。

「GPT 5.3 Codex Spark」の主要な機能と技術的特徴

「GPT-5.3-Codex-Spark」は、その圧倒的な速度とリアルタイム性を特徴とし、開発者のコーディング体験を根本的に変革することを目指して設計されました。このモデルは「GPT-5.3-Codex」の小型版として位置づけられ、リアルタイムでの対話的なコーディング作業に特化し最適化されています2。

その主要な機能と技術的特徴は以下の通りです。

リアルタイムコーディングに特化した対話能力

「GPT-5.3-Codex-Spark」は、開発者がAIの作業中に介入し、即座にターゲットを絞った編集、ロジックの微調整、インターフェースの洗練を行えるよう設計されています2。これにより、AIが人間の思考に同期するかのようにコードを生成・修正できるようになり、開発者はよりインタラクティブかつ効率的に作業を進めることが可能になります8。

Cerebras WSE-3チップによる超高速推論

このモデルは、Cerebras Systemsの専用チップ「Wafer Scale Engine 3 (WSE-3)」上で動作することで、1秒あたり1,000トークン以上の超高速推論を実現しています1。これはOpenAIとCerebrasの提携による最初の成果であり、その革新的なハードウェアが「GPT-5.3-Codex-Spark」の圧倒的な速度とリアルタイム性の基盤を築いています1。

大幅な低遅延を実現するインフラ最適化

OpenAIは、エンドツーエンドのレイテンシーを大幅に削減するためにインフラを最適化しました。これにより、クライアント・サーバー間のラウンドトリップオーバーヘッドを80%削減し、トークンあたりのオーバーヘッドを30%削減、そして最初のトークン表示までの時間(Time-To-First-Token)を50%短縮しています4。これらの改善は、開発者がAIとの連携においてほとんど遅延を感じることなく、自然な思考の流れでコーディングできる環境を提供します。

リアルタイムでの協調作業能力

開発者がAIの作業中に介入し、編集、ロジック調整、インターフェースの洗練を即座に行える協調作業能力は、開発プロセスに大きな影響を与えます。従来のモデルでは、AIの出力を待ってから修正を加える必要がありましたが、「GPT-5.3-Codex-Spark」では、AIがコードを生成している最中でも人間がその流れに介入し、リアルタイムで方向性を修正することが可能です2。このシームレスな連携により、開発のイテレーションサイクルが短縮され、よりクリエイティブで効率的なコーディングが促進されます。

パフォーマンスと「速度と精度のトレードオフ」

ベンチマークテストにおいて、「GPT-5.3-Codex-Spark」はSWE-Bench ProやTerminal-Bench 2.0でGPT-5.1-Codex-miniよりも高速かつ高精度な応答を示しています1。しかし、より大規模な「GPT-5.3-Codex」と比較すると精度は劣るものの、タスク完了速度が大幅に速いという「速度と精度のトレードオフ」が本モデルの大きな特徴です5。これは、リアルタイム性が求められるインタラクティブなコーディングタスクにおいて、その真価を発揮することを示しています。

その他の技術的特徴

「GPT-5.3-Codex-Spark」は、128kトークンのコンテキストウィンドウを備え、テキスト入力のみに対応しています2。これは、広範なコードベースや関連ドキュメントを一度に参照しながら作業できることを意味します。利用形態としては、リサーチプレビューとしてChatGPT Proユーザー向けに提供されており、Codexアプリ、CLI、VS Code拡張機能で利用可能です2。また、APIアクセスも一部の設計パートナー向けに提供が開始されており、順次拡大される予定です1。

結論と今後の展望

リアルタイムコーディングを革新する「GPT-5.3-Codex-Spark」

本調査により、「GPT-5.3-Codex-Spark」がOpenAIから公式にリリースされた、リアルタイムコーディングに特化した画期的なAIモデルであることが確認されました。その主要な特徴は、Cerebras Systemsの専用チップ「Wafer Scale Engine 3 (WSE-3)」との連携と、OpenAI独自のインフラ最適化によって実現された超高速推論とリアルタイム性に集約されます 1。このモデルは、1秒あたり1,000トークンを超える推論速度と、エンドツーエンドのレイテンシーを大幅に削減した低遅延性能を誇り、開発者がAIと人間の思考に同期するかのように対話的なコーディング作業を進めることを可能にします 1。

開発プロセスへの変革的影響

「GPT-5.3-Codex-Spark」の登場は、ソフトウェア開発のプロセスに根本的な変革をもたらす可能性を秘めています。開発者はモデルの作業中にリアルタイムで介入し、ターゲットを絞った編集、ロジックの微調整、インターフェースの洗練を即座に行うことができるようになります 2。これにより、AIと人間が密接に連携し、よりインタラクティブかつ効率的に協調作業を進める「人・AI協調開発」という新しいパラダイムが確立されるでしょう 8。従来のコード生成AIが提示されたコードを後からレビュー・修正するプロセスであったのに対し、Sparkは開発者の思考サイクルに沿ってコードを生成・修正することで、開発スピードと品質の両面で大幅な向上を期待できます。

AI技術の進化における位置づけと将来展望

「GPT-5.3-Codex-Spark」は、コード生成に特化したGPTモデル群の最新の進化形であり、特に「速度と精度のトレードオフ」において、従来のモデル「GPT-5.3-Codex」が持つ高い精度と自律的エージェント能力を補完する形で、リアルタイム性という新たな価値を提案しています 5。 既存の「GPT-5.3-Codex」が、数時間から数日にわたる長期的なタスクを自律的に実行し、自己改善能力を示すエージェント型モデルとして注目されていることを踏まえると 13、Sparkのリアルタイム性は、このような高度なエージェントが人間とのインタラクションをよりスムーズに行う上での重要な要素となるでしょう。人間がAIの作業にリアルタイムで介入し、方向性を修正できる「Steering(操縦)」機能 13は、Sparkの超高速性を最大限に活かし、AIがまるで人間の拡張された思考の一部であるかのように機能する未来を示唆しています。

AIと人間の協調作業の未来と開発者コミュニティへの影響

「GPT-5.3-Codex-Spark」は、開発者コミュニティに対し、AIを単なるツールではなく、共同作業者(コパイロット)として捉える視点を提供します。ルーチンワークの高速化により、開発者はより創造的で複雑な問題解決や、高レベルな設計、戦略的思考に集中できるようになります。これにより、イノベーションの加速、新規参入障壁の低下、そしてソフトウェア開発全体の生産性向上が期待されます。未来の開発環境では、リアルタイムAIアシスタンスが標準となり、開発者はAIとのシームレスな協調を通じて、これまで不可能だった新たな価値を創造していくことになるでしょう。